در این ماه، OpenAI جدید را اعلام کرد سیستم هوش مصنوعی مولد به نام Sora، که فیلم های کوتاهی را از پیام های متنی تولید می کند. در حالی که Sora هنوز در دسترس عموم نیست، کیفیت بالای خروجی های نمونه منتشر شده تاکنون هر دو را برانگیخته است برانگیخته و نگران واکنش ها

را نمونه فیلم ها منتشر شده توسط OpenAI، که شرکت می گوید مستقیماً توسط Sora بدون تغییر ایجاد شده است، خروجی هایی از اعلان هایی مانند “فیلم تصویری نزدیک از دو کشتی دزدان دریایی در حال نبرد با یکدیگر در حالی که در داخل یک فنجان قهوه حرکت می کنند” و “تصاویر تاریخی کالیفرنیا در طول طلا” را نشان می دهد. هجوم بردن”.

در نگاه اول، اغلب دشوار است که بگوییم آنها توسط آنها تولید می شوند هوش مصنوعیبه دلیل کیفیت بالای فیلم ها، بافت ها، پویایی صحنه ها، حرکات دوربین و سطح خوبی از سازگاری.

سام آلتمن، مدیر اجرایی OpenAI، همچنین برای نشان دادن قابلیتهای سورا، ویدیوهایی را در X (توئیتر سابق) که در پاسخ به درخواستهای پیشنهادی کاربر ایجاد شده بود، پست کرد.

سورا چگونه کار می کند؟

سورا ویژگی های ابزارهای تولید متن و تصویر را در چیزی که “مدل ترانسفورماتور انتشار“

ترانسفورماتورها ابتدا یک نوع شبکه عصبی هستند در سال ۲۰۱۷ توسط گوگل معرفی شد. آنها بیشتر به دلیل استفاده در مدل های زبان بزرگ مانند ChatGPT و Google Gemini شناخته شده اند.

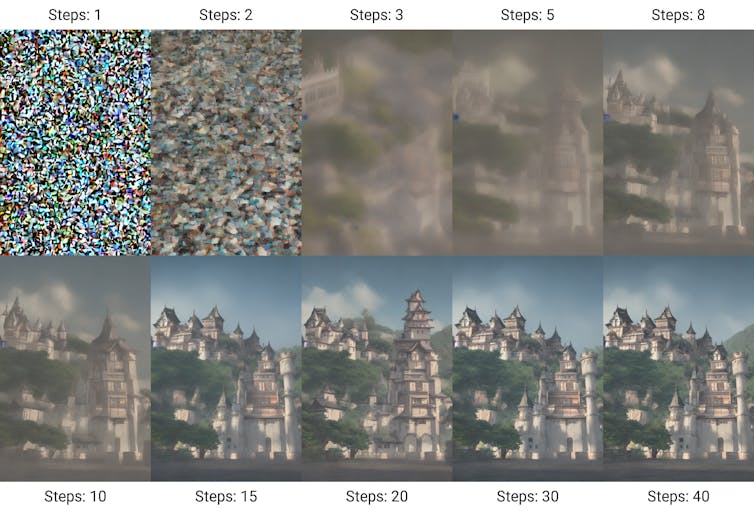

از سوی دیگر، مدلهای انتشار، پایه و اساس بسیاری از تولیدکنندگان تصویر هوش مصنوعی هستند. آنها با شروع با نویز تصادفی و تکرار به سمت یک تصویر “تمیز” که متناسب با یک اعلان ورودی است، کار می کنند.

از دنباله ای از چنین تصاویری می توان یک ویدیو ساخت. با این حال، در یک ویدیو، انسجام و سازگاری بین فریم ها ضروری است.

سورا از معماری ترانسفورماتور برای رسیدگی به نحوه ارتباط فریم ها با یکدیگر استفاده می کند. در حالی که ترانسفورماتورها در ابتدا برای یافتن الگوهایی در نشانه هایی که متن را نشان می دهند طراحی شده بودند، سورا در عوض از نشانه هایی استفاده می کند که نشان دهنده متن هستند. تکه های کوچک مکان و زمان.

رهبری بسته

سورا اولین مدل تبدیل متن به ویدئو نیست. مدل های قبلی گنجانده شده است Emu توسط متا Gen-2 توسط باند، انتشار ویدئوی پایدار توسط Stability AI، و اخیرا لومیر توسط گوگل

Lumiere که چند هفته پیش منتشر شد ادعا کرد برای تولید ویدیوی بهتر از نسخه های قبلی خود. اما به نظر می رسد که سورا حداقل در برخی موارد از لومیر قدرتمندتر است.

Sora میتواند ویدیوهایی با وضوح حداکثر ۱۹۲۰ × ۱۰۸۰ پیکسل و نسبتهای مختلف تولید کند، در حالی که Lumiere به ۵۱۲ × ۵۱۲ پیکسل محدود شده است. ویدیوهای Lumiere حدود ۵ ثانیه طول می کشد، در حالی که Sora ویدیوهایی تا ۶۰ ثانیه می سازد.

Lumiere نمی تواند ویدیوهای متشکل از چندین عکس بسازد، در حالی که Sora می تواند. سورا، مانند مدل های دیگر، همچنین قادر به کارهای ویرایش ویدیو مانند ایجاد فیلم از تصاویر یا ویدیوهای دیگر، ترکیب عناصر از ویدیوهای مختلف، و گسترش ویدیوها در زمان است.

هر دو مدل ویدیوهای کاملاً واقع گرایانه تولید می کنند، اما ممکن است از توهم رنج ببرند. ویدیوهای Lumiere ممکن است راحت تر به عنوان تولید شده توسط هوش مصنوعی تشخیص داده شوند. ویدیوهای سورا پویاتر به نظر می رسند و تعاملات بیشتری بین عناصر دارند.

با این حال، در بسیاری از ویدئوهای نمونه، ناسازگاری ها با بررسی دقیق آشکار می شوند.

برنامه های امیدوار کننده

محتوای ویدیویی در حال حاضر یا با فیلمبرداری از دنیای واقعی یا با استفاده از جلوه های ویژه تولید می شود که هر دوی این موارد می تواند هزینه بر و زمان بر باشد. اگر Sora با قیمت مناسب در دسترس قرار گیرد، ممکن است افراد شروع به استفاده از آن به عنوان یک نرم افزار نمونه سازی برای تجسم ایده ها با هزینه بسیار کمتر کنند.

بر اساس آنچه از قابلیت های سورا می دانیم، حتی می توان از آن برای ایجاد ویدیوهای کوتاه برای برخی از برنامه های کاربردی در سرگرمی، تبلیغات و آموزش استفاده کرد.

OpenAI مقاله فنی در مورد سورا عنوان “مدل های تولید ویدئو به عنوان شبیه سازهای جهانی” است. این مقاله استدلال میکند که نسخههای بزرگتر از ژنراتورهای ویدئویی مانند سورا ممکن است «شبیهسازهای توانمند دنیای فیزیکی و دیجیتالی، و اشیاء، حیوانات و افرادی که در آنها زندگی میکنند» باشند.

اگر این درست باشد، نسخههای بعدی ممکن است کاربردهای علمی برای آزمایشهای فیزیکی، شیمیایی و حتی اجتماعی داشته باشند. برای مثال، ممکن است بتوان تأثیر سونامیهای با اندازههای مختلف را بر روی انواع زیرساختها و سلامت جسمی و روانی افراد نزدیک آزمایش کرد.

دستیابی به این سطح از شبیه سازی بسیار چالش برانگیز است و برخی کارشناسان می گویند سیستمی مانند Sora اساسا ناتوان از انجام آن

یک شبیه ساز کامل باید واکنش های فیزیکی و شیمیایی را در دقیق ترین سطوح کیهان محاسبه کند. با این حال، شبیه سازی تقریبی تقریبی از جهان و ساختن ویدیوهای واقع گرایانه برای چشم انسان ممکن است در سال های آینده در دسترس باشد.

خطرات و نگرانی های اخلاقی

نگرانی های اصلی در مورد ابزارهایی مانند Sora حول تاثیر اجتماعی و اخلاقی آنها می چرخد. در دنیایی از قبل گرفتار اطلاعات نادرستابزارهایی مانند سورا ممکن است اوضاع را بدتر کنند.

به راحتی می توان فهمید که چگونه می توان از توانایی تولید ویدیوی واقعی از هر صحنه ای که می توانید توصیف کنید، برای انتشار اخبار جعلی متقاعد کننده یا ایجاد شک و تردید در فیلم واقعی استفاده شود. ممکن است اقدامات بهداشت عمومی را به خطر بیندازد، برای تأثیرگذاری بر انتخابات مورد استفاده قرار گیرد، یا حتی بر سیستم قضایی فشار بیاورد شواهد جعلی احتمالی.

ژنراتورهای ویدیو همچنین ممکن است تهدیدهای مستقیم برای افراد هدف را از طریق دیپ فیک – به ویژه – فعال کنند پورنوگرافیک. اینها ممکن است عواقب وحشتناکی بر زندگی افراد آسیب دیده و خانواده های آنها داشته باشد.

فراتر از این نگرانی ها، مسائل مربوط به کپی رایت و مالکیت معنوی نیز وجود دارد. ابزارهای مولد هوش مصنوعی به مقادیر زیادی داده برای آموزش نیاز دارند و OpenAI فاش نکرده است که داده های آموزشی Sora از کجا آمده است.

مدل های زبان بزرگ و تولید کننده های تصویر نیز به همین دلیل مورد انتقاد قرار گرفته اند. در ایالات متحده، الف گروهی از نویسندگان مشهور از OpenAI شکایت کرده اند در مورد سوء استفاده احتمالی از مواد خود. این پرونده استدلال میکند که مدلهای زبان بزرگ و شرکتهایی که از آنها استفاده میکنند، کار نویسندگان را برای ایجاد محتوای جدید میدزدند.

این اولین بار در حافظه اخیر نیست که فناوری از قانون جلوتر است. به عنوان مثال، مسئله تعهدات پلتفرمهای رسانههای اجتماعی در تعدیل محتوا، بحثهای داغی را در چند سال گذشته ایجاد کرده است – بیشتر آن حول محور میچرخد. بخش ۲۳۰ قانون ایالات متحده.

در حالی که این نگرانی ها واقعی هستند، بر اساس تجربیات گذشته، ما انتظار نداریم که آنها توسعه فناوری تولید ویدیو را متوقف کنند. OpenAI می گوید قبل از در دسترس قرار دادن Sora برای عموم، “چندین گام مهم ایمنی” را انجام می دهد، از جمله همکاری با کارشناسان در زمینه “اطلاعات غلط، محتوای نفرت انگیز، و سوگیری” و “ساخت ابزارهایی برای کمک به شناسایی محتوای گمراه کننده”.

وحید پوریوسفکاندیدای دکتری تعامل انسان با کامپیوتر، دانشگاه موناش و لونی بزانسوناستادیار در تجسم داده ها، دانشگاه لینشوپینگ

این مقاله بازنشر شده است از گفتگو تحت مجوز Creative Commons. را بخوانید مقاله اصلی.

منبع: https://thenextweb.com/news/what-is-sora-new-generative-ai-tool-video-production-risks